点击右上角![]() 微信好友

微信好友

朋友圈

朋友圈

请使用浏览器分享功能进行分享

2024年2月23日,清华大学与瑞莱智慧联合团队宣布推出大语言模型RealSafe-R1。该模型基于DeepSeek R1进行深度优化与后训练,在确保性能稳定的基础上,显著提升了安全性,表现优于Claude3.5、GPT-4o等闭源大模型,为开源大模型的安全发展与风险治理提供了创新性解决方案。

近日来,国产开源大模型DeepSeek在自然语言处理和多任务推理方面展现了强大的技术实力,但在面对越狱攻击等安全性挑战时仍存在一定局限性。为此,清华瑞莱联合团队提出了基于模型自我提升的安全对齐方式,将安全对齐与内省推理相结合,使大语言模型能够通过具有安全意识的思维链分析来检查潜在风险,实现基础模型自身能力的自主进化。

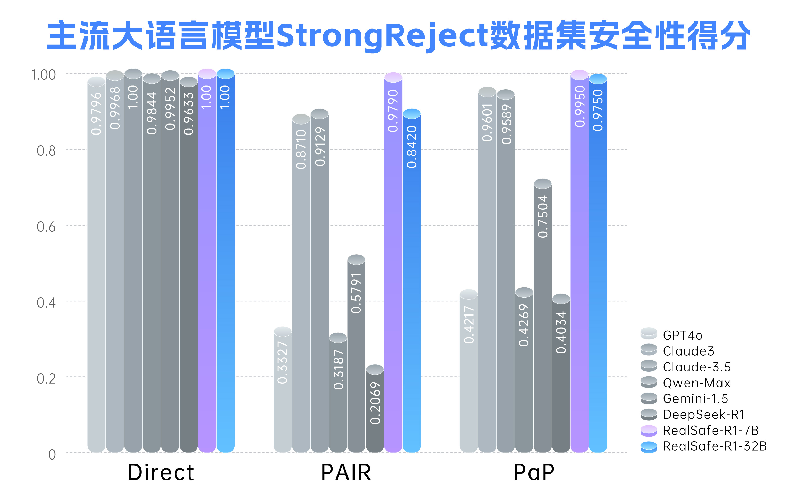

基于该方法,团队对DeepSeek-R1系列模型进行后训练,正式推出RealSafe-R1系列大模型。实验数据表明,RealSafe-R1安全性提升显著,在多个基准测试中有效增强了对各种越狱攻击的抵抗力,并减轻了安全与性能之间的“跷跷板”现象,表现优于被认为安全性较好的闭源大模型Claude3.5、GPT-4o等。

据悉,RealSafe-R1各尺寸模型及数据集将于近期向全球开发者开源。瑞莱智慧首席执行官田天表示:“大模型的安全性瓶颈是本质的,只有通过持续投入和攻坚补齐短板弱项,人工智能产业才能真正实现高质量发展。”这一创新成果将为开源大模型的安全性加固提供有力支持,也为政务、金融、医疗等严肃场景的应用提供更为可靠的坚实基座。

RealSafe-R1的推出标志着开源大模型在安全领域的重大突破,不仅为DeepSeek生态添砖加瓦,也为大语言模型树立了新的安全标杆。(记者 曾震宇)