点击右上角![]() 微信好友

微信好友

朋友圈

朋友圈

请使用浏览器分享功能进行分享

随着人工智能技术的进步,与发展机遇一同到来的,是风险和挑战。如今,一些不法分子利用AI技术融合他人面孔和声音,从而制造逼真的虚假合成图像,用以实施新型网络诈骗等违法行为。如何看清这类AI“深度造假”行为成为时下需要关注的热点。

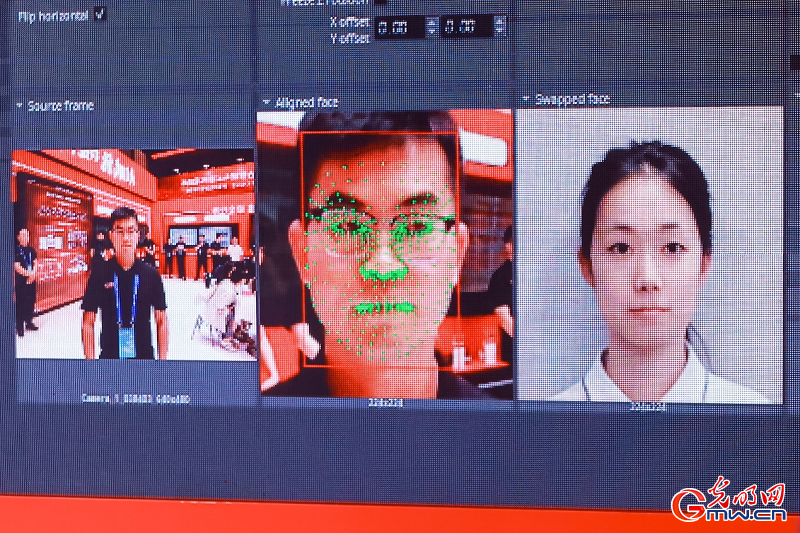

“只需一张正面静态照片,借助人工智能技术,就能变成你的好友与你对话。”在2024年国家网络安全宣传周网络安全博览会现场,天融信科技集团的工作人员正向参观者展示AI换脸技术的惊人能力。只见随着工作人员简单操作,摄像头便开始捕捉其面部变化。与此同时,屏幕上一张“陌生”的女性面孔就能随着男性工作人员的表情变化而“动”起来,二者表情变化几近一致。现场观众表示,令人惊讶的同时,确实“细思极恐”。

工作人员现场演示AI换脸技术

工作人员介绍,AI换脸过程主要包括人脸识别追踪、面部特征提取、人脸变换融合、背景环境渲染、图像与音频合成等几个关键步骤。其背后的原理可大致概括为三个部分:利用深度学习算法精准识别视频中人脸图像,提取关键面部特征;将上述特征与目标人脸图像进行匹配、替换、融合;通过背景环境渲染并添加合成后的声音,生成逼真度较高的虚假换脸视频。

“以诈骗为目的,实施点对点视频通话,需要AI人工智能生成仿真度极高的视频。而想要达到以假乱真效果用于诈骗,难度不小。”工作人员表示,只要稍加留心,AI换脸还是有明显破绽,“马脚”就在面部轮廓和光线,可以仔细观察下是否清晰。有必要的话,还可以要求对方快速大幅度地做点头等动作,从而观察其面部轮廓是否有异常模糊。

眼见不一定为实。这类AI换脸技术的非法应用,也在一定程度上提醒着我们,日常应提高个人信息保护意识,做好相关防范措施,加强对人脸、声纹、指纹等生物特征数据的安全防护。遇到疑似AI换脸的情况时也要多留一分警惕,谨防被骗。(记者 雷渺鑫)